Introduction à la logique et l’algèbre de Boole

Sans aucun doute l’un des chercheurs les plus influents dans la mathématique moderne, George Boole et son approche de la logique algébrique. Concept fortement ancré dans la logique de circuit et en informatique, ce type d’algèbre permet produire une abstraction qui, aussi simple pouvant être, permet de pousser de nombreux concepts.

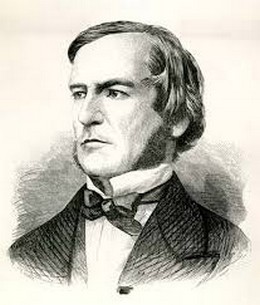

George Boole

Les premières publications dans le domaine remonte au 19ème siècle, bien que l’oeuvre et les rédaction de Boole se voient démocratiser au courant du siècle suivant, notamment par l’ingénieur électrique Claude Shannon qui utilise les concept de Boole afin de proposer la théorie de l’information.

Dans sa publication de 1948, Shannon propose une manière de représenter la communication en suivant un principe d’algèbre Booléen et ainsi mathématiser le principe de communication (c’est un peu plus poussé que cela).

Un peu d’histoire

Comme son nom l’indique, l’algèbre de Boole vient du mathématicien George Bool, reconnu comme étant un autodidacte ayant commencé ses reflexions très jeune. Mort avant même l’âge de 50 ans, Boole s’est rapidement vu récompensé par ses reflexions, notamment par la remise de la médaille royale en 1944.

Boole est également reconnu pour avoir publié de nombreuses thèses sur les équations différentielles, les probabilités et l’analyse. Reconnu dès son jeune âge comme étant polyvalent, ses multiples publications dans le domaine de la mathématique touchent à de nombreuses facette de cette science.

Son travail le plus notable reste sans aucun doute l’algèbre booléen, qui pris près d’une dizaine d’années à créer. C’est entre 1844 et 1854 que Boole propose un algèbre possédant seulement deux valeurs, les 1 et les 0. Étant mentionné ainsi, il pourrait être facile de crier à la simplicité de cette abstraction, cependant notons ici en quoi le génie de l’homme se résume par la simplicité pragmatique de concepts pouvant être représenté de manière informatique et électrique.

Les circuits électriques et Claude Shannon

La beauté de l’algèbre de Boole est cette manière de transposer un ensemble en seulement deux valeurs. La finalité de ces equations pouvant paraitre monotone, le chemin pour s’y rendre résume d’une excitation palpable lors des premières applications aux domaines des technologies, quelques décennie après le décès de Boole.

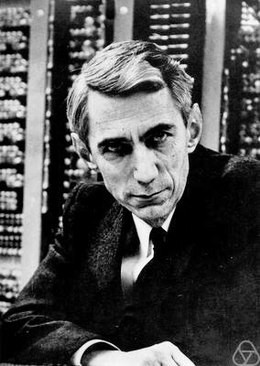

De l’autre côté de l’océan, dans le midwest américain du début du 20ème siècle voit le jour un des chercheurs et génie à qui l’ont doit encore beaucoup près de cent ans plus tard. Prenant les concepts de Boole, Claude Shannon étudiant en mathématique et génie électrique à l’université du Michigan et ensuite au MIT propose la théorie de l’information. À partir de son papier original, il est possible d’en dériver une multitude de sujets ayant été influencé par le travail de cet homme. Notons ici la cryptographie et la compression de données.

Claude Shannon

Une théorie mathématique de la communication

L’une de ces publications ayant permis de nombreux avancements dans le domaine des télécommunications reste son oeuvre encore étudié et mis comme lecture obligatoire dans de nombreuses universités. Comme mentionné plus tard, il s’agit avant tout d’une rédaction scientifique ayant été retranscrit en livre quelques années plus tard par Weaven Weaver y ajoutant ses commentaires.

Durant la deuxième grande guerre, Shannon est amené à travailler pour les services secrets de l’armée américaine dans le domaine de la cryptographie. Son papier est en premier lieu considéré comme travail secret, malgré l’importance de son contenu, ce n’est qu’en 1980 que ce dernier est déclassifié.

Le travail de Claude Shannon s’inspire de l’algèbre Booléen et l’applique à une problématique plus concrète afin de proposer une unité de mesure, qui permet de représenter la logique booléenne en unité de mesure. Cette unité de mesure, qui popularise la notion du mot bit, s’inspire de la conjecture AND et OR de l’algèbre Booléen afin de représenter une logique numérique.